Jedes zweite Unternehmen stoppt KI-Projekte: CoreView nennt 51 Prozent weltweit. Studien zeigen, warum Sicherheits-, Governance- und Datenprobleme AI-Vorhaben ausbremsen.

Jedes zweite Unternehmen stoppt KI-Projekte wegen Sicherheits- und Governance-Bedenken

Jedes zweite Unternehmen stoppt KI-Projekte – mit dieser Aussage lässt sich eine Entwicklung zusammenfassen, die in vielen IT- und Security-Teams bereits praktisch angekommen ist. CoreView berichtet, dass 51 Prozent der befragten Organisationen weltweit und 46 Prozent in Deutschland KI-getriebene Änderungen wegen Sicherheits- oder Governance-Bedenken wieder zurückgenommen haben. Gemeint sind damit Änderungen im produktiven Betrieb und nicht pauschal das vollständige Ende sämtlicher KI-Initiativen. Dieser CoreView-Bericht ist deshalb bemerkenswert, weil sie zeigt, dass KI-Vorhaben nicht nur an Nutzenversprechen gemessen werden, sondern ebenso an Kontrollierbarkeit, Berechtigungen, Freigaben und Nachvollziehbarkeit.

Die Erhebung basiert auf einer Befragung von 500 IT- und Security-Führungskräften in Organisationen mit jeweils mehr als 1.000 Microsoft-365-Nutzern. Ergänzend verweist CoreView auf Tenant-Daten aus Umgebungen mit insgesamt mehr als 1,6 Millionen Nutzern. Im selben Zusammenhang nennt der Bericht weitere Kennzahlen, die den Hintergrund für gestoppte oder zurückgenommene KI-Änderungen erklären. 82 % der Befragten beschreiben den Plattformbetrieb als erhebliche operative Belastung. 43 % berichten von verzögerten oder gescheiterten Audits wegen langsamer, unvollständiger oder manueller Reporting-Prozesse. Hinzu kommt Widerstand aus dem Management gegen den KI-Einsatz, wenn Sicherheitsbedenken und fehlende Kontrollmechanismen nicht ausgeräumt sind.

Warum jedes zweite Unternehmen KI-Projekte stoppt

Im Mittelpunkt stehen nach den CoreView-Angaben drei operative Fragen. In den Key Takeaways zum 2026 State of AI in Microsoft 365 Report formuliert das Unternehmen diese Punkte klar: Wer überprüft KI-getriebene Änderungen, bevor sie in produktive Abläufe eingreifen? Wie weit reichen die Rechte der Systeme, die solche Änderungen vorbereiten oder ausführen? Und lassen sich einzelne Aktionen im Nachhinein eindeutig nachvollziehen und bei Bedarf zurückrollen? Sobald Unternehmen diese Fragen nicht belastbar beantworten können, steigt der Steuerungsaufwand. Gerade in Umgebungen mit vielen Identitäten, Berechtigungen, Richtlinien und Konfigurationsänderungen wird AI damit zu einem Thema für Governance und Betriebsmodell, nicht nur für Automatisierung.

Dass dieses Muster nicht auf einen einzelnen Bericht beschränkt ist, zeigt eine Untersuchung von S&P Global. Dort heißt es, dass der Anteil der Unternehmen, die den Großteil ihrer AI-Initiativen noch vor der Produktion wieder aufgeben, innerhalb eines Jahres von 17 auf 42 % gestiegen ist. Im Durchschnitt werden 46 Prozent der Projekte zwischen Proof of Concept und breiter Einführung verworfen. Unternehmen mit niedrigeren Abbruchquoten priorisieren Projekte laut der Studie häufiger nach Compliance, Risiko und Datenverfügbarkeit. Damit rückt dieselbe Frage in den Mittelpunkt, die auch im CoreView-Bericht sichtbar wird: Ob ein KI-Projekt produktiv mehrwertstiftende ausgerollt werden kann, entscheidet sich nicht nur an Modellleistung oder Geschwindigkeit, sondern an Datenreife, Governance und operativer Steuerbarkeit.

Hinzu kommen strukturelle Ursachen, die RAND in einer eigenen Analyse zu gescheiterten KI-Projekten beschreibt. Genannt werden dort vor allem unklare Problemdefinitionen, fehlende oder ungeeignete Daten, ein zu starker Fokus auf die Technologie statt auf den eigentlichen Anwendungsfall, unzureichende Infrastruktur für Datenmanagement und Deployment sowie AI-Einsätze für Probleme, die sich mit dem gewählten Ansatz nur begrenzt lösen lassen. Für Unternehmen ergibt sich daraus ein wiederkehrendes Bild:

KI-Projekte werden häufig dort gestoppt, wo Sicherheitsfragen, Datenqualität, Prozesse und Verantwortlichkeiten nicht gemeinsam mit dem Anwendungsfall geplant wurden.

Jedes zweite Unternehmen stoppt KI-Projekte dort, wo die Kontrollierbarkeit fehlt

Die aktuelle Entwicklung spricht nicht für ein nachlassendes Interesse an AI. CoreView berichtet zugleich, dass 70 % der IT-Verantwortlichen KI-getriebene Administration weiterhin als wertvoll einschätzen. Der Unterschied liegt damit nicht zwischen Einsatz und Verzicht, sondern zwischen produktiver Einführung und kontrollierter Einführung. Unternehmen wollen AI nutzen, bremsen aber dort, wo die Auswirkungen auf Berechtigungen, Konfigurationen, Inhalte oder sicherheitsrelevante Abläufe nicht ausreichend abgesichert sind.

Diese Trennlinie ist für den Praxisbetrieb entscheidend. AI-Systeme greifen in Unternehmen nicht isoliert auf einen einzigen Prozess zu. Sie analysieren Inhalte, priorisieren Informationen, unterstützen administrative Entscheidungen, erzeugen Empfehlungen oder stoßen selbstständig weitere Schritte an. Damit verlagert sich die Verantwortung von der Frage, ob ein Modell grundsätzlich funktioniert, hin zur Frage, wie mit seinen Ergebnissen operativ umgegangen wird. Ohne klare Zuständigkeiten, definierte Freigaben, protokollierte Änderungen und nachvollziehbare Rollback-Mechanismen wird aus einem Effizienzprojekt schnell ein Governance-Thema.

Welche Gründe hinter gestoppten KI-Projekten am häufigsten stehen

Aus den vorliegenden Berichten lassen sich fünf Ursachen besonders klar ableiten.

- Erstens fehlt in vielen Fällen ein präzise definierter Anwendungsfall mit nachvollziehbarem Geschäftsnutzen.

- Zweitens ist die Datenbasis oft unvollständig, uneinheitlich oder für den produktiven Einsatz nicht ausreichend kontrolliert.

- Drittens werden Berechtigungen, menschliche Aufsicht und technische Freigaben nicht immer mit derselben Priorität geplant wie die Einführung der AI-Funktion selbst.

- Viertens entstehen Probleme im laufenden Betrieb, wenn Reporting, Auditierbarkeit und Revisionsfähigkeit nicht mit dem Automatisierungsgrad Schritt halten.

- Fünftens bleiben Projekte dort häufiger stecken, wo Unternehmen KI auf Prozesse setzen, die organisatorisch noch gar nicht standardisiert genug sind.

Gerade dieser letzte Punkt erklärt, warum KI-Projekte in Unternehmen oft nicht vollständig beendet, sondern gestoppt, verkleinert oder neu gescoped werden. In vielen Fällen scheitert nicht die Technologie allein, sondern die Einbettung in reale Betriebsabläufe. Sobald ein Pilot in den produktiven Maßstab wechselt, steigen die Anforderungen an Kontrolle, Dokumentation, Risikosteuerung und Verantwortlichkeit deutlich an. Dort zeigt sich, ob KI tatsächlich als Produktivitätsinstrument funktioniert oder ob zusätzliche Aufwände für Security, Compliance und Betrieb entstehen.

Was Unternehmen tun können, damit KI-Projekte Mehrwert liefern

Für den weiteren Ausbau produktiver KI-Nutzung lassen sich aus den in den Studien beschriebenen Problemen mehrere Maßnahmen ableiten. KI-Projekte sollten erst dann in die Produktion gehen, wenn Anwendungsfall, Datenbasis und Erfolgskriterien vorab eindeutig festgelegt sind. Ebenso wichtig sind ein enges Rechte- und Rollenkonzept, verbindliche Freigabeprozesse, vollständige Protokollierung und die Möglichkeit, Änderungen später nachvollziehen und kontrolliert zurücknehmen zu können. Unklare Zuständigkeiten, zu breite Berechtigungen, fehlende Transparenz und unzureichende Revisionsfähigkeit werden durch diese Ansätze adressiert.

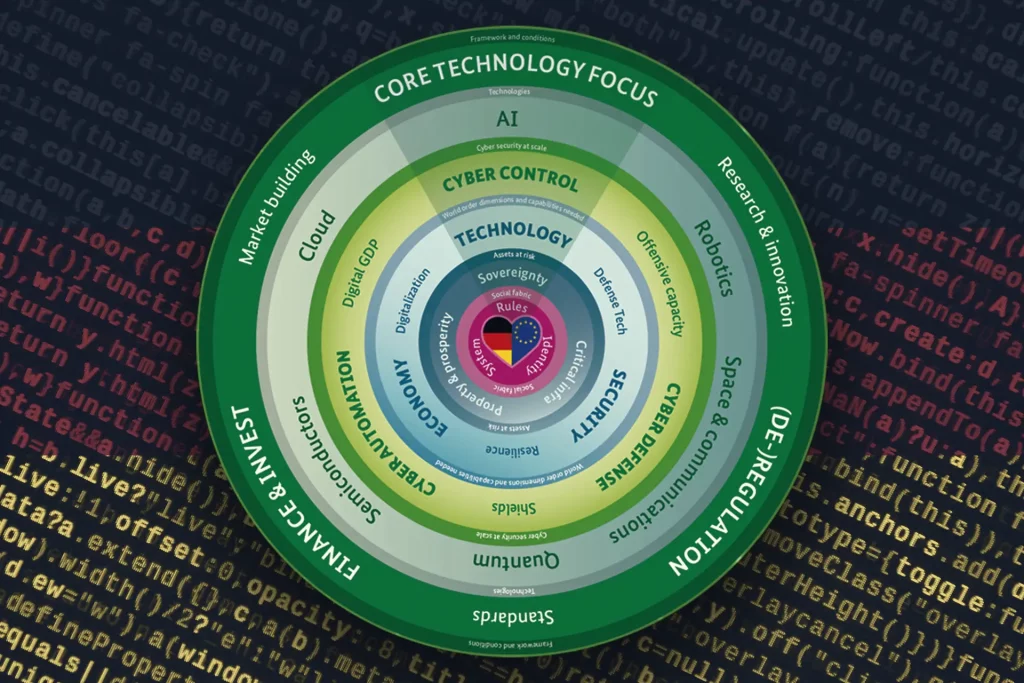

Auf organisatorischer Ebene bietet sich dafür ein formales KI-Governance-Modell an. ISO/IEC 42001 beschreibt die Anforderungen an ein AI-Managementsystem und gibt damit einen Rahmen für Verantwortlichkeiten, Richtlinien, Kontrollen, Monitoring und kontinuierliche Verbesserung vor. ISO/IEC 23894 ergänzt diesen Ansatz um eine strukturierte Anleitung für AI-bezogenes Risikomanagement und hilft dabei, Risiken in bestehende Governance- und Kontrollprozesse zu integrieren. ISO/IEC 38507 richtet sich an Leitungs- und Managementebene und beschreibt, wie der Einsatz von KI so gesteuert werden kann, dass er wirksam, effizient und organisatorisch akzeptabel bleibt. Für die operative Umsetzung bietet das NIST AI Risk Management Framework einen praxisnahen Rahmen, mit dem sich Risiken über den Lebenszyklus von KI-Systemen hinweg identifizieren, bewerten, steuern und laufend überprüfen lassen.

Zusammengenommen helfen diese Ansätze dabei, KI-Projekte robuster aufzusetzen: mit klaren Zuständigkeiten, dokumentierten Entscheidungen, nachvollziehbaren Kontrollen und einem Risikobild, das nicht erst nach dem Rollout entsteht. Für Unternehmen bedeutet das vor allem, Governance nicht als nachgelagerte Compliance-Aufgabe zu behandeln, sondern als Voraussetzung für einen produktiven und belastbaren KI-Einsatz.